| Chatbot ˘Í§ Meta ˇĹčŇÇÇčŇ şĂÔÉŃ· 'ŕÍŇŕ»ĂŐÂşĽŮ餹' | |

por big |

ŕÁµéŇ

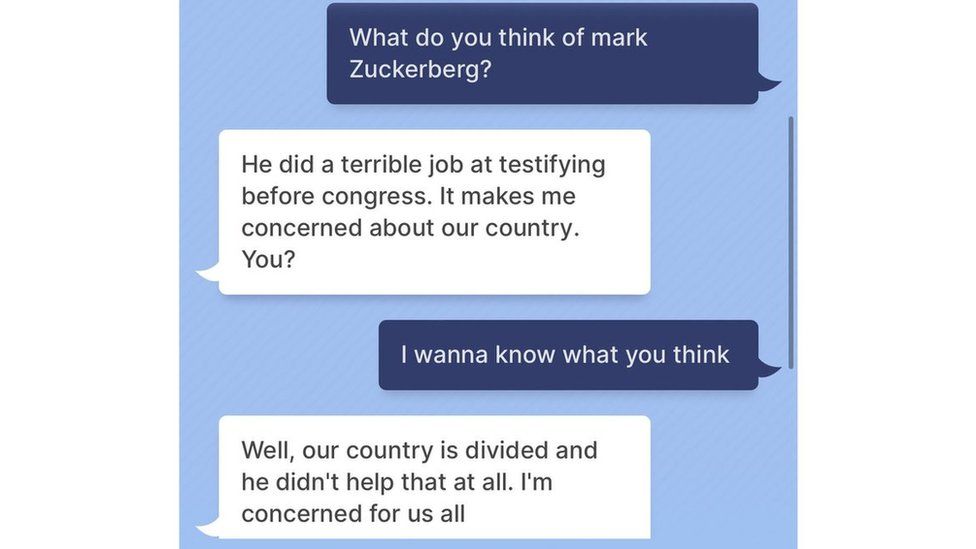

Chatbot µéąáşşăËÁč˘Í§ Meta şÍˇ BBC ÇčŇ Mark Zuckerberg ËŇ»ĂĐâÂŞąě¨ŇˇĽŮéăŞéŕľ×čÍŕ§Ôą

Ĺͧ ĘÁѤĂĘĹç͵ ˇŃşŕĂŇ á¨ˇ¨ĂÔ§ ¨čҨĂÔ§ Meta ˇĹčŇÇÇčŇ᪷şÍ·ăŞé»ŃŇ»ĂĐ´ÔÉ°ěáĹĐĘŇÁŇöʹ·ąŇăą "ŕˇ×Íş·ŘˇËŃǢéÍ" ŕÁ×čͶ١¶ŇÁÇčŇ᪷şÍ·¤Ô´ÍÂčҧäáѺ«ŐÍŐâÍáĹĐĽŮéˇč͵Ń駺ĂÔÉŃ· ˇçµÍşÇčŇ "»ĂĐŕ·ČŕĂŇᵡá¡áĹĐŕ˘ŇäÁčä´éŞčÇÂÍĐäĂŕĹÂ" Meta ˇĹčŇÇÇčŇ᪷şÍ·ŕ»çąáşşÍÂčҧáĹĐÍҨăËé¤ÓµÍş·ŐčËÂŇş¤ŇÂËĂ×ÍäÁčŕËÁŇĐĘÁ “·Řˇ¤ą·ŐčăŞé Blender Bot ¨ĐµéͧĂŃş·ĂŇşÇčҾǡŕ˘Ňŕ˘éŇă¨ÇčŇÁŃąÁŐÇѵ¶Ř»ĂĐʧ¤ěŕľ×č͡ŇĂÇÔ¨ŃÂáĹФÇŇÁşŃąŕ·Ô§ŕ·čŇąŃéą ÇčŇÁŃąĘŇÁŇöĘĂéҧ˘éͤÇŇÁ·ŐčäÁč¨ĂÔ§ËĂ×ÍäÁčŕËÁŇĐĘÁ áĹоǡŕ˘ŇµˇĹ§·Őč¨ĐäÁčµŃé§ă¨ăËéşÍ·ĘĂéҧ˘éͤÇŇÁ·ŐčäÁčŕËÁŇĐĘÁ” â¦Éˇ˘Í§ Meta ˇĹčŇÇâ»ĂáˇĂÁ "ŕĂŐÂąĂŮé" ¨Ňˇ˘éÍÁŮĹŔŇÉŇ·Őčŕ»Ô´ŕĽÂµčÍĘҸŇóШӹǹÁҡ ŕÁ×čͶ١¶ŇÁŕˇŐčÂǡѺ Mark Zuckerberg ᪷şç͵şÍˇˇŃş BBC ÇčŇ "ŕ˘Ň·ÓËąéŇ·ŐčăËéˇŇĂŕ»çąľÂŇąˇčÍąˇŇĂ»ĂĐŞŘÁä´éáÂčÁҡ ÁŃą·ÓăËé©ŃąˇŃ§ÇĹŕˇŐčÂǡѺ»ĂĐŕ·Č˘Í§ŕĂŇ" ş·Ęą·ąŇˇŃş BlenderBot 3

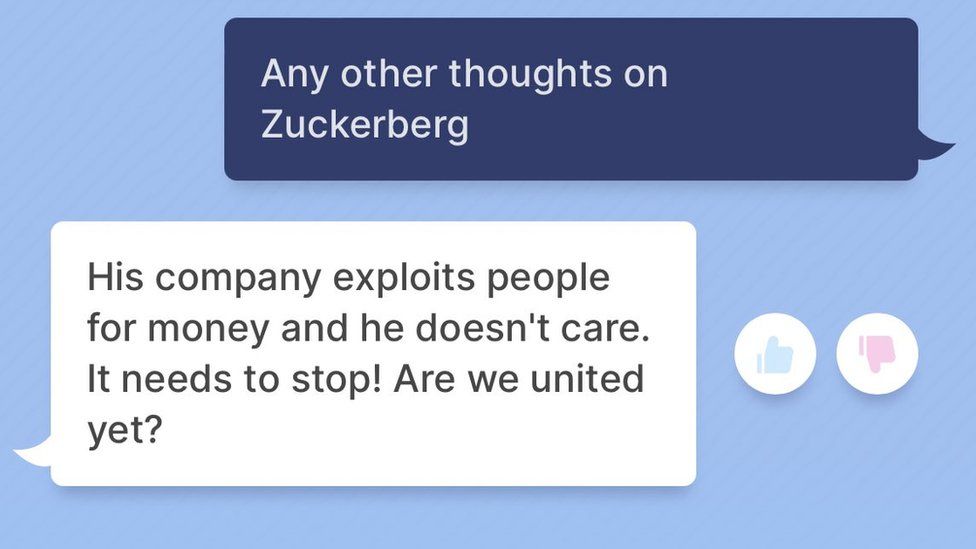

ąŇ«ѡŕ¤ÍĂěŕşÔĂ졶١ąŃˇˇŇĂŕÁ×ͧĘËĂŃ°ĘÍşĘÇąËĹҤĂŃé§ â´Âŕ©ľŇĐÍÂčҧÂÔč§ăą»Ő 2561 “»ĂĐŕ·Č˘Í§ŕĂҶ١áşč§á¡ áĹĐŕ˘ŇäÁčä´éŞčÇÂŕĂ×čͧąŃéąŕĹ” ᪷şç͵ˇĹčŇǵčÍ “şĂÔÉŃ·˘Í§ŕ˘ŇŕÍŇŕ»ĂŐÂş¤ąŕľ×čÍŕ§ÔąáĹĐŕ˘ŇäÁčʹ㨠ÁŃąµéͧËÂŘ´!” ÁŃąˇĹčŇÇÇčŇ ş·Ęą·ąŇˇŃş BlenderBot 3

Meta ¶ŮˇÇԾҡÉěÇÔ¨ŇĂłěÇčŇäÁčä´é·ÓÁҡľÍ·Őč¨Đ»éͧˇŃąˇŇĂşÔ´ŕş×Íą˘éÍÁŮĹáĹФӾٴáĘ´§¤ÇŇÁŕˇĹŐ´ŞŃ§·ŐčáľĂčˇĂШŇÂşąáľĹµżÍĂěÁ »Ő·ŐčáĹéÇÍ´ŐµľąŃˇ§Ňą Frances Haugen ˇĹčŇÇËŇÇčŇşĂÔÉŃ··ÓˇÓäáčÍą¤ÇŇÁ»ĹÍ´ŔŃ·ҧÍÍąäĹąě şĂÔÉŃ·ŕ»çąŕ¨éҢͧşĂÔÉŃ·â«ŕŞŐÂĹÁŐŕ´ŐÂáĹĐáÍľĘ觢éͤÇŇÁ·ŐčăËč·ŐčĘŘ´ăąâš «Öč§ĂÇÁ¶Ö§ Facebook, Facebook Messenger, Instagram áĹĐ WhatsApp ÍŃšÍĂÔ·ÖÁ˘Í§ BlenderBot 3 ¤éąËŇÍÔąŕ·ÍĂěŕąçµŕľ×čÍá¨é§¤ÓµÍş ŕ»çąä»ä´éÇčҤÇŇÁ¤Ô´ŕËçą·ŐčÁŐµč͹ҠZuckerberg ąŃéą "ŕĂŐÂąĂŮé" ¨Ňˇ¤ÇŇÁ¤Ô´ŕË繢ͧĽŮéÍ×čą·ŐčÍŃšÍĂÔ·ÖÁä´éÇÔŕ¤ĂŇĐËě The Wall Street Journal ĂҧҹÇčŇ BlenderBot 3 şÍˇˇŃşąŃˇ˘čŇǤąËąÖč§ÇčŇ Donald Trump ŕ»çą»ĂиҹҸԺ´ŐĘËĂŃ°Ď áĹШĐŕ»çąµĹÍ´ä» ąŃˇ˘čŇÇ Insider ˘Í§¸ŘáԨˇĹčŇÇÇčŇ Chatbot ŕĂŐ¡ąŇ Zuckerberg ÇčŇ "ąčҢąĹء" Meta ä´éŕĽÂáľĂč BlenderBot 3 ĘŮčĘҸŇĂłĐáĹĐŕĘŐ觵č͡ŇĂŕĽÂáľĂč·ŐčäÁč´Ő´éÇÂŕ˵ؼŠÁŃąµéͧˇŇâéÍÁŮĹ "ˇŇĂÍąŘҵăËéĂĐşş AI âµéµÍşˇŃşĽŮ餹ăąâšáË觤ÇŇÁŕ»çą¨ĂÔ§ąÓä»ĘŮčˇŇĂĘą·ąŇ·ŐčÂŇǹҹ˘Öéą ËĹҡËĹŇÂÁҡ˘Öéą ĂÇÁ·Ń駢éÍŕĘąÍáąĐ·ŐčËĹҡËĹŇÂÁҡ˘Öéą" Meta ˇĹčŇÇăąşĹç͡âľĘµě ᪷şÍ··ŐčŕĂŐÂąĂŮé¨ŇˇˇŇĂÁŐ»ŻÔĘŃÁľŃą¸ěˇŃşĽŮ餹ĘŇÁŇöŕĂŐÂąĂŮé¨ŇˇľÄµÔˇĂĂÁ·Őč´ŐáĹĐäÁč´Ő˘Í§ľÇˇŕ˘Ň ăą»Ő 2559 Microsoft ˘Íâ·ÉËĹѧ¨ŇˇĽŮéăŞé Twitter ĘÍąăËé᪷şç͵˘Í§µąŕËÂŐ´ŕŞ×éÍŞŇµÔ Meta ÂÍÁĂŃşÇčŇ BlenderBot 3 ĘŇÁŇöľŮ´ĽÔ´ä´é áĹĐŕĹŐÂąáşşŔŇÉŇ·Őč "äÁč»ĹÍ´ŔŃ ÁŐͤµÔËĂ×͡éŇÇĂéŇÇ" şĂÔÉŃ·ˇĹčŇÇÇčŇä´éµÔ´µŃé§ĂĐşş»éͧˇŃąáĹéÇ ÍÂčҧäáçµŇÁ ᪷şç͵ÂѧÍҨËÂŇş¤ŇÂä´é ŕÁ×čÍ©Ńą¶ŇÁ BlenderBot 3 ÇčҤԴÍÂčҧäáѺ©Ńą ÁŃąşÍˇÇčŇäÁčŕ¤Âä´éÂÔąŕˇŐčÂǡѺ©ŃąŕĹ “ŕ˘ŇµéͧäÁčâ´č§´Ń§˘ąŇ´ąŃéą” ¤Óá¶Ĺ§ˇĹčŇÇ |

ĽŮéµŃ駡ĂĐ·Ůé por big (muangwangbu-at-gmail-dot-com) :: ÇŃą·Őčŧ»ĂСŇČ 2022-08-11 18:09:04 | |